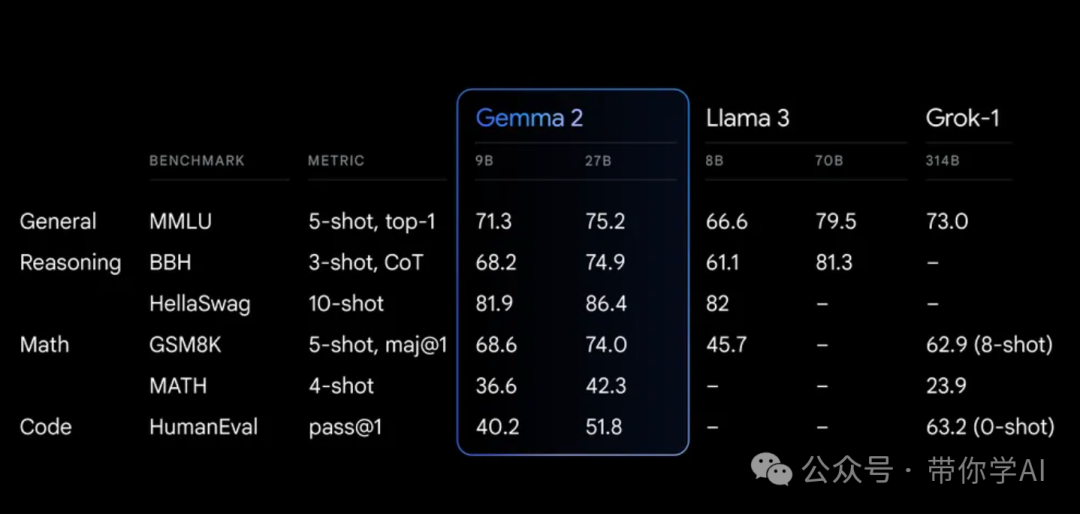

2024年6月28日在I/O Connect大会上,谷歌宣布了其最新一代顶尖开源模型—Gemma 2。Gemma 2提供了两种参数规模选择:90亿(9B)和270亿(27B)。其中,27B模型经过训练处理了13万亿个tokens,而9B模型则是8万亿个tokens。此外,谷歌还将很快发布一个参数规模为26亿(2.6B)的模型,其设计足够小巧,可以在手机本地上运行。

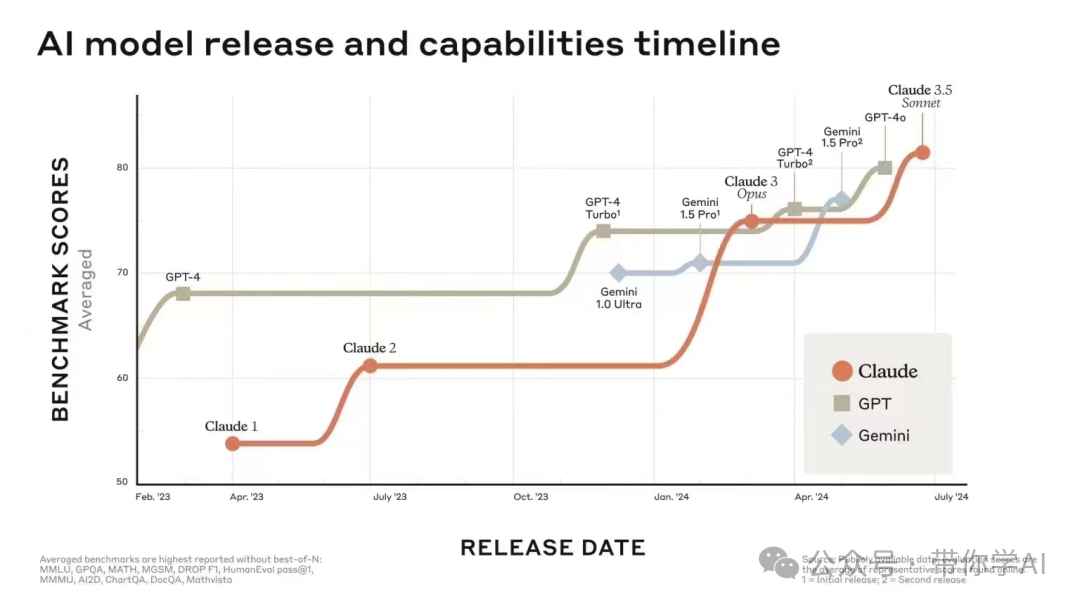

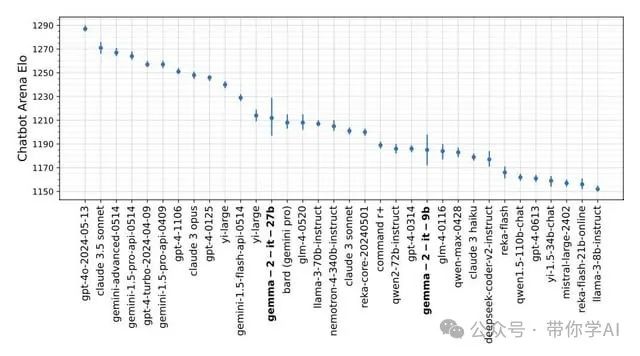

AI领域竞争激烈,GPT-4o和Claude 3.5 Sonnet持续发力,谷歌迅速跟进。除了Gemini模型外,谷歌推出了Gemma系列轻量级SOTA开放模型,旨在让每个人都能构建AI工具。Gemma 2有90亿(9B)和270亿(27B)参数两个版本,性能和效率优于第一代,并具有显著的安全性改进。270亿参数版本可以与体积超过其两倍的模型竞争,且可在单个NVIDIA H100 Tensor Core GPU或TPU主机上实现,从而大大降低部署成本。

谷歌在今年早些时候推出轻量级先进开源模型Gemma,只有2B和7B参数版本,下载量超过1000万次。谷歌团队在重新设计的架构上构建了Gemma 2。

更加优化

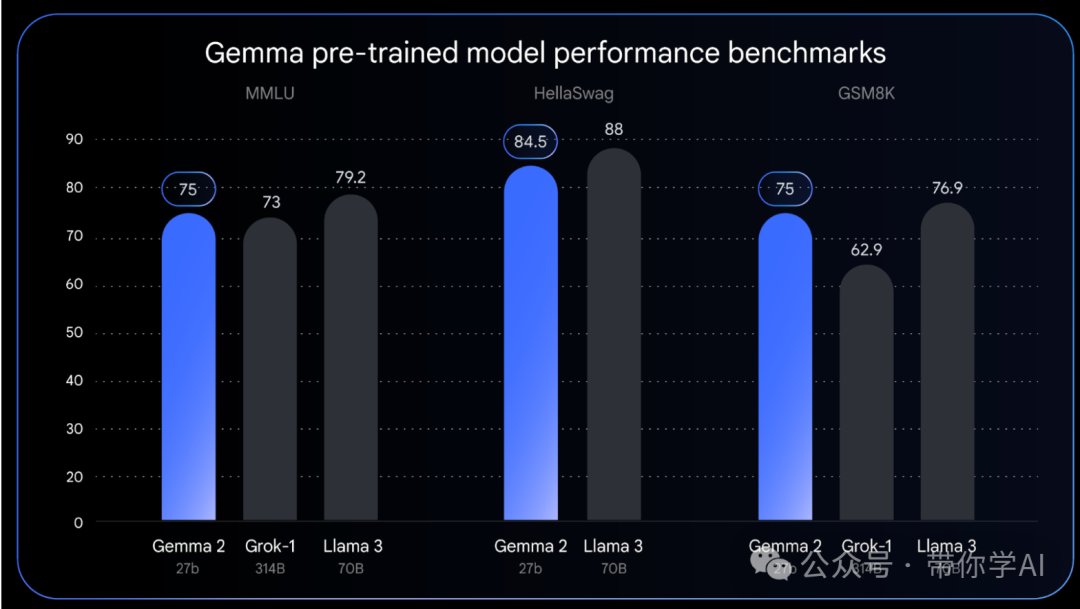

- Gemma 2性能卓越:27B型号在同类产品中领先,9B型号优于Llama 3 8B及其他同类开放模型。

- 27B型号可在单个Google Cloud TPU主机、NVIDIA A100 80GB或H100 GPU上高效运行,显著降低成本。

- Gemma 2优化了跨硬件的超快推理,可在从游戏笔记本电脑到云设置的各种硬件上运行,并可在Google AI Studio、CPU上的Gemma.cpp量化版本以及配备NVIDIA RTX的家用电脑上试用。

更加开放

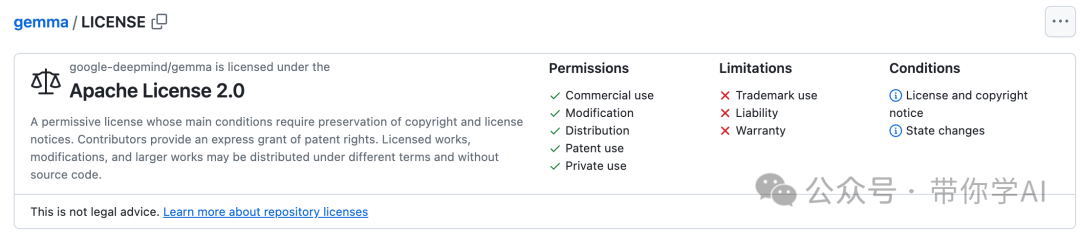

- 开放且易于访问:与原始Gemma模型一样,Gemma 2使开发者和研究人员在获得许可后可以使用。

- Gemma 2兼容主要AI框架(如Hugging Face Transformers、JAX、PyTorch、TensorFlow等),支持原生Keras 3.0和vLLM,优化NVIDIA TensorRT-LLM及NeMo,现可用Keras和Hugging Face微调,未来将提供更多高效微调选项。

- 轻松部署:从下个月开始,Google Cloud客户可以在Vertex AI上轻松部署和管理Gemma 2。

更加专业

- Gemma 2通过交替使用局部滑动窗口注意力(4096个token)和全局注意力(8192个token)层,既能细致捕捉文本细节,又能全面理解上下文。

- Gemma通过对每个注意层和最终层的logits进行软封顶,将logits限制在固定范围内,有效提升了训练稳定性并防止内容过长。

- GQA通过将算力集中于注意力分组内,提升数据处理速度,同时保持下游性能。

更加安全

致力于为开发人员和研究人员提供构建和部署AI所需的资源,包括负责任生成AI工具包。最近,谷歌开源了LLM Comparator,可以帮助评估语言模型,并通过Python库进行比较和可视化。此外,谷歌正致力于为Gemma模型开源文本水印技术SynthID。

在训练Gemma 2时,遵循了严格的内部安全流程,过滤预训练数据,并根据全面指标进行了测试,以识别和减轻偏见和风险。还发布了大量与安全和代表性损害相关的公共基准测试结果。

总结

谷歌的开源AI模型战略主要走亲民路线,可以让人人都可以部署运行,全球各地任何人都可以使用Gemma。谷歌将继续探索新的架构并开发专门的 Gemma 变体,以应对更广泛的 AI 任务和挑战。可以说旨在进一步弥合轻量级可访问性和强大性能之间的差距,为人们的 AI 创作解锁新的性能和潜力水平。