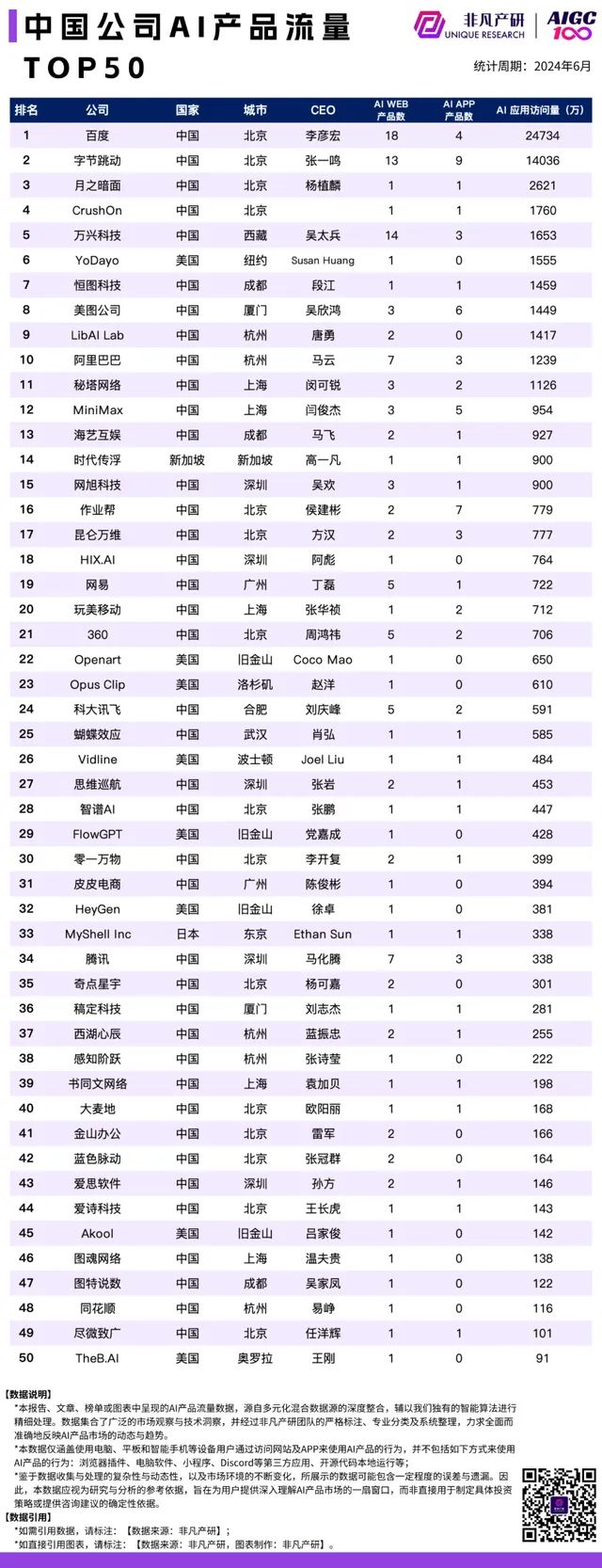

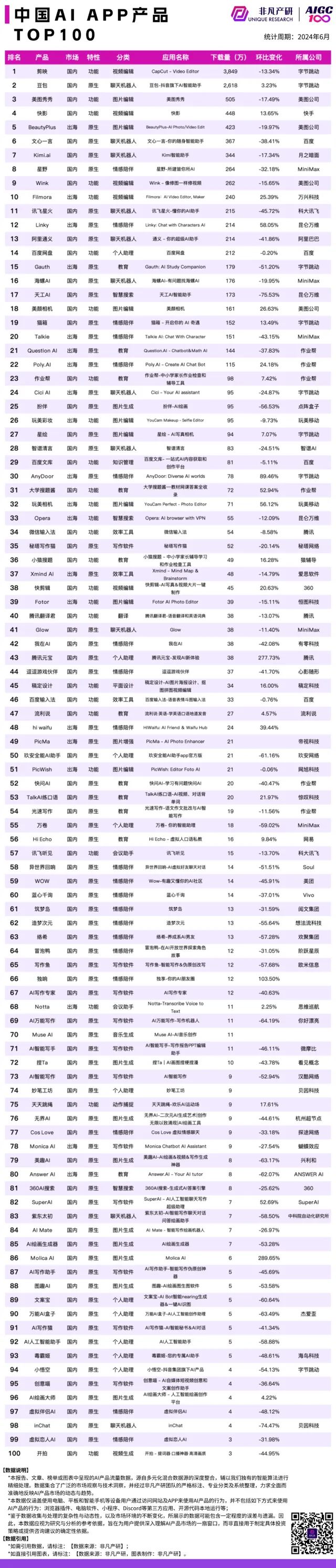

1-1. 非凡对全球近万个AI产品的持续追踪,推出2024年6月AI产品榜单:AIGC软件万兴科技强势入围中国公司AI产品流量第五,一同上榜的有百度、字节跳动、月之暗面及CrushOn

榜单显示:

1. 全球范围内,以ChatGPT、Bing、Canva、Character.ai为代表的聊天机器人、智慧搜索、平面设计、情感陪伴类产品仍占据市场主流;2. 国内市场中,排名前四的公司均以聊天机器人为主要产品,万兴科技凭借创意软件产品在众多企业中突出重围,显示出多媒体内容AI生成工具的市场潜力。

万兴科技全球累计用户超15亿,被视为“中国版Adobe”,旗下海外AI创意平台Media.io、视频创意软件Filmora、在线原型设计工具墨刀、多功能视音频处理软件UniConverter、AIGC“真人”营销视频创作神器Virbo。

https://mbd.baidu.com/ma/s/oynkQbjd

1-2. AI原生互动侦探游戏 AI Alibis:免费、免下载、免注册、中文友好、浏览器运行,短时间内就在Hackers news上登顶第一

AI Alibis是国外网友Paul Scotti用anthropic模型做出的一种由AI虚拟成员组成的解密探案游戏。故事背景改编自韩国电视剧《犯罪现场》的S02E11山庄谋杀案。

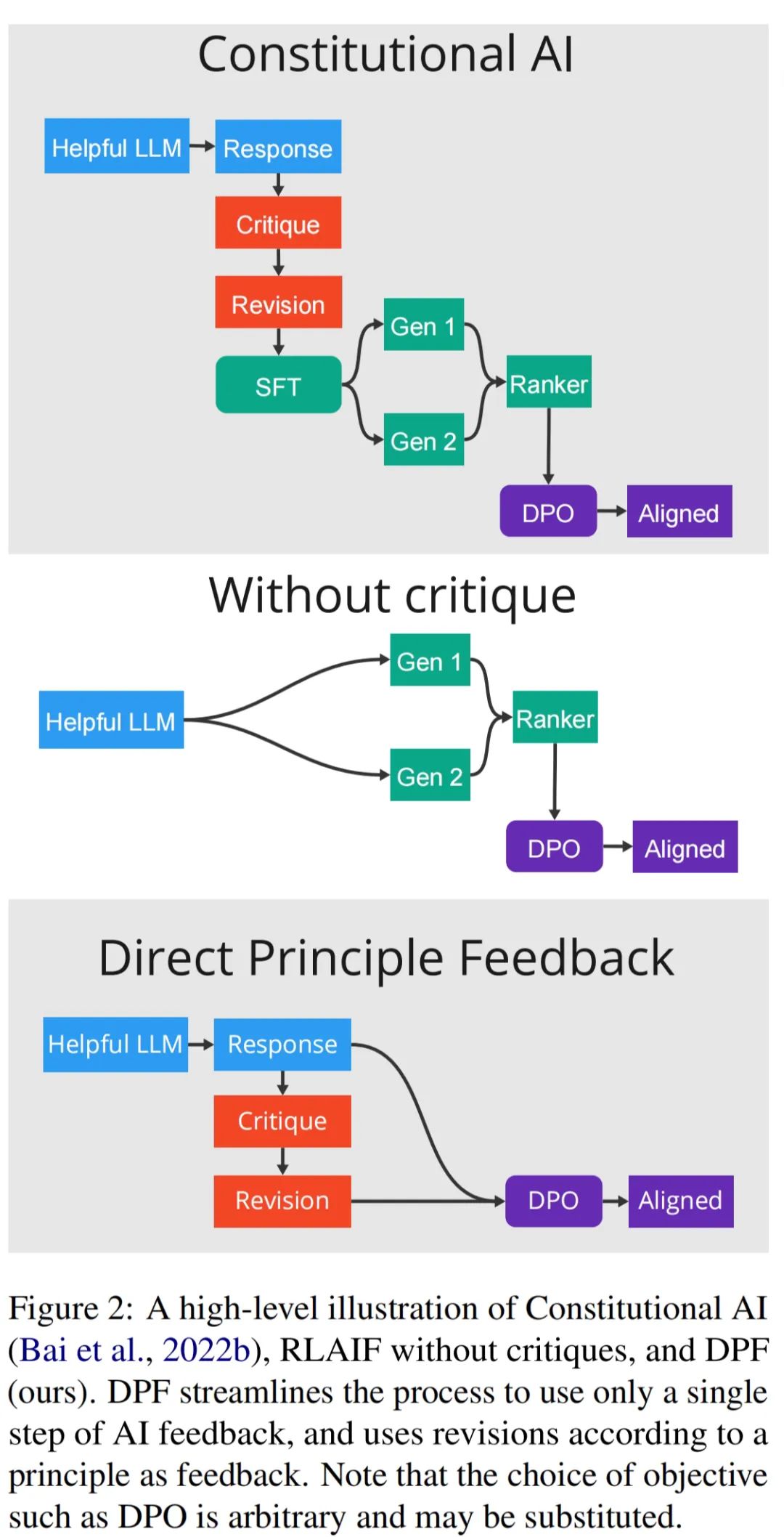

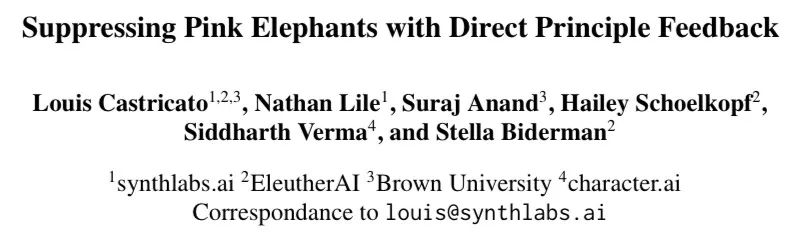

是那种让你动脑筋、玩策略的游戏,故事会随着你的选择不断变化,而且每次玩都能碰到不同的结局。研发者在训练AI不出错时用到的批判与修订方法、违规机器人检查器等技术,AI Alibis里还加入了“粉红大象”的研究原理(所谓的“粉红大象效应”,其实就是用直接原则反馈(DPF)的方法,让LLM不去讨论粉红象,转而讨论去讨论灰色象)

https://www.qbitai.com/2024/07/166129.html

在线试玩:https://ai-murder-mystery.onrender.com/

注:所谓的“粉红大象效应”,其实就是用直接原则反馈(DPF)的方法,让LLM不去讨论粉红象,转而讨论去讨论灰色象,主要算法流程:

参考论文:Suppressing Pink Elephants with Direct Principle Feedback

参考论文地址:https://arxiv.org/abs/2402.07896

1-3. Nature上的一项研究,与AI聊天机器人同伴Replika交流一个多月后:3%参与者停止自杀念头,或撬动数十亿美金市场

前段时间,MIT的一位社会学家正在研究,AI聊天机器人为人类提供的亲密关系(artificial intimacy)——包括那些已婚人士。 另一方面,亲密「幻觉」一家约会应用公司Match Group的市值现在是90亿美元。一些人将会打造一个AI版的Match Group,甚至可能赚到10亿美元以上。

AI女友、AI男友,在现实中的案例,比比皆是。若说它们真实情感的存在虚无缥缈,但不得不承认的是,确实给人们带去了益处。Nature上的一项研究发现,在与AI聊天机器人同伴Replika交流一个多月后,3%的参与者停止了自杀的念头。

https://www.163.com/dy/article/J6VPJJHN0511ABV6.html

Replika如何对用户的心理健康产生积极的影响

论文名称: Loneliness and suicide mitigation for students using GPT3-enabled chatbots

论文地址: https://www.nature.com/articles/s44184-023-00047-6

AI大模型算法和峰会

2-1. Mamba-2-Hybrid:Token生成速度比Transformer加速了将近8×,准确度更高

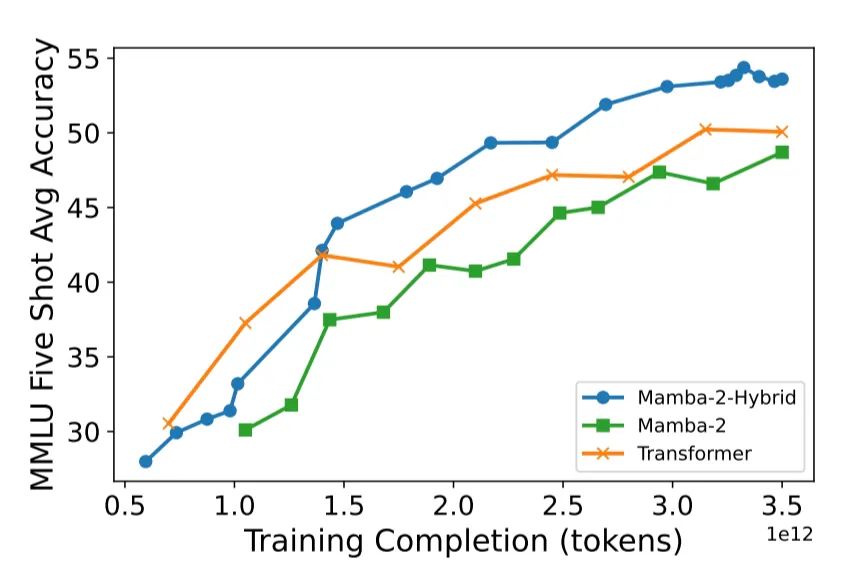

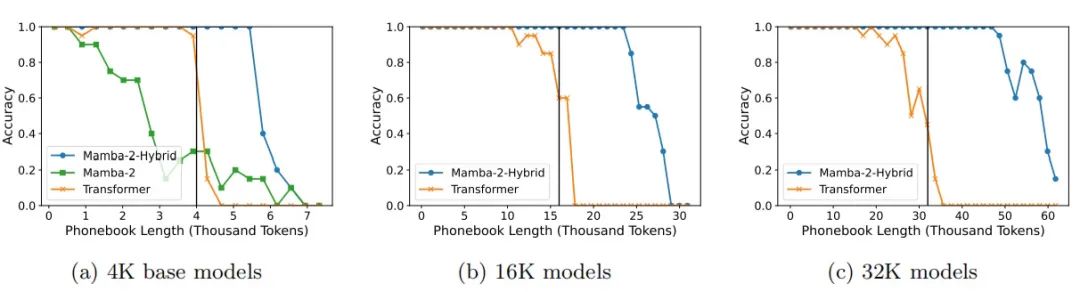

论文开头的评估结果表明,在更大训练预算的情况下,Mamba依旧能在下游任务上超过Transformer,但上下文学习和信息检索能力有所局限。 基于此,作者提出的混合架构模型Mamba-2-Hybrid能够在提高效率的同时继续表现出比Transformer更强大的性能,并弥补了纯SSM架构的相关缺陷。这项研究所展示的全面结果告诉我们,Mamba和Transformer这两种架构各有长短,也许并不需要其中一个取代另一个,将二者结合起来是一条值得探索的、有巨大潜力的路径。

https://www.163.com/dy/article/J6VP8HAS0511ABV6.html

在Mamba系列表现较差的「电话簿」任务上,Mamba-2-Hybrid可以在预训练上下文长度(4K) 内以近乎完美的精度完成电话簿任务,还可以稍微超出该长度进行泛化,在最多5.5k token的电话簿上实现100%准确率。

论文名称:An Empirical Study of Mamba-based Language Models

论文地址:https://arxiv.org/pdf/2406.07887

2-2. OpenAI新模型「草莓」曝光:强推理/长任务规划/超大规模训练,有望接近人类水平

OpenAI正在开发一个名为“草莓(Strawberry)”的新模型,它的前身是Q*。其工作机制在内部被严格保密,且细节从未被外界报道过。 消息称,“草莓”模型不仅在超大规模数据集上完成预训练,并且采用了一种特殊的方法。包括后训练(post-training);或者在已经进行大规模训练后,再调整基础模型来“磨炼”性能。

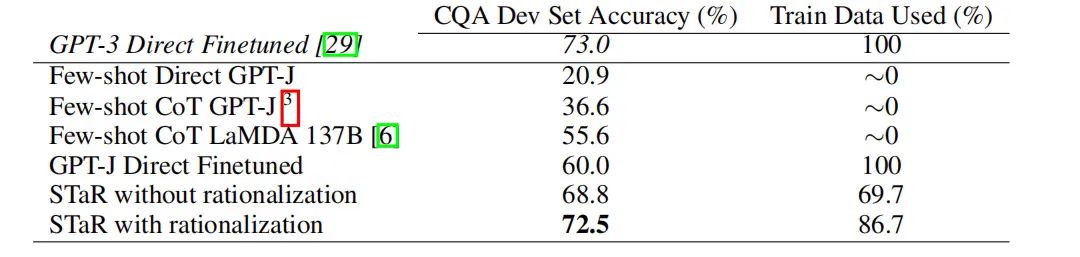

后训练部分包括常见的微调、人类反馈强化学习(RLHF)等。一位知情人士透露,“草莓”与斯坦福大学提出一种名为自学推理(Self-Taught Reasoner,简称STaR)的方法很相似。OpenAI在一次内部全体会议上展示了demo。据称该项目推理能力已接近人类水平。

https://www.qbitai.com/2024/07/166072.html

论文名称:StaR:Self-Taught Reasoner Bootstrapping Reasoning With Reasoning

论文地址:https://arxiv.org/pdf/2203.14465

2-3. Meta 公司计划 7 月 23 日发布开源 AI 模型 Llama 3-405B:推出 4050 亿参数版本,打造最强开源大模型

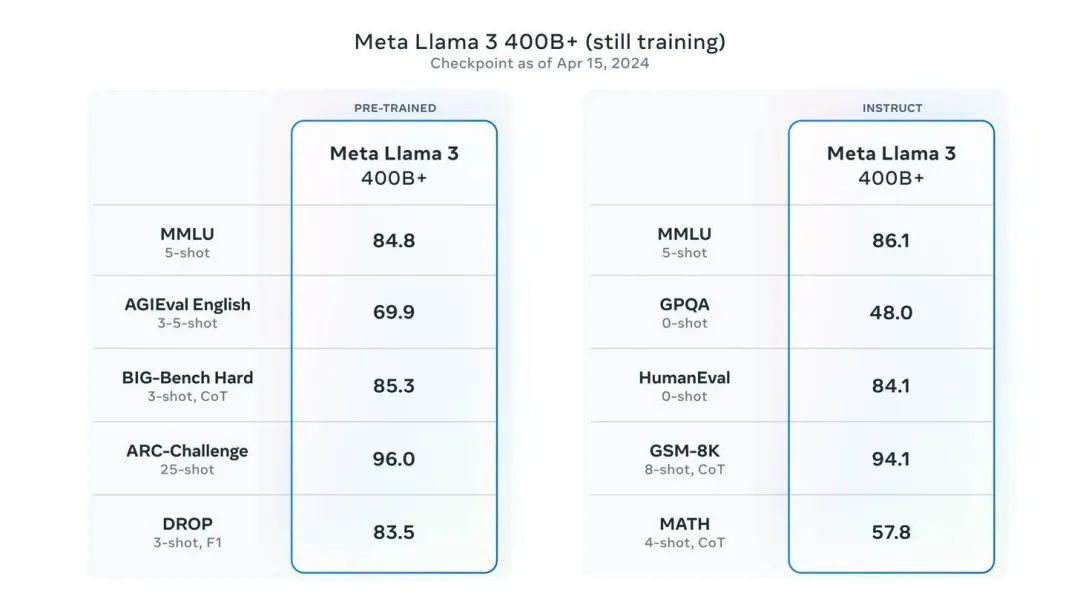

报道称 Llama 3-405B 是一个多模态 AI 开源模型,能够理解图像、文本等多种媒体内容。 Meta 公司今年 4 月发布 Llama 3 AI 模型时,扎克伯格就在采访中透露正在训练 4050 亿像素的密集模型,但当时没有透露太多的信息。

https://mbd.baidu.com/ma/s/At9XBGus