AI应用进展和演化

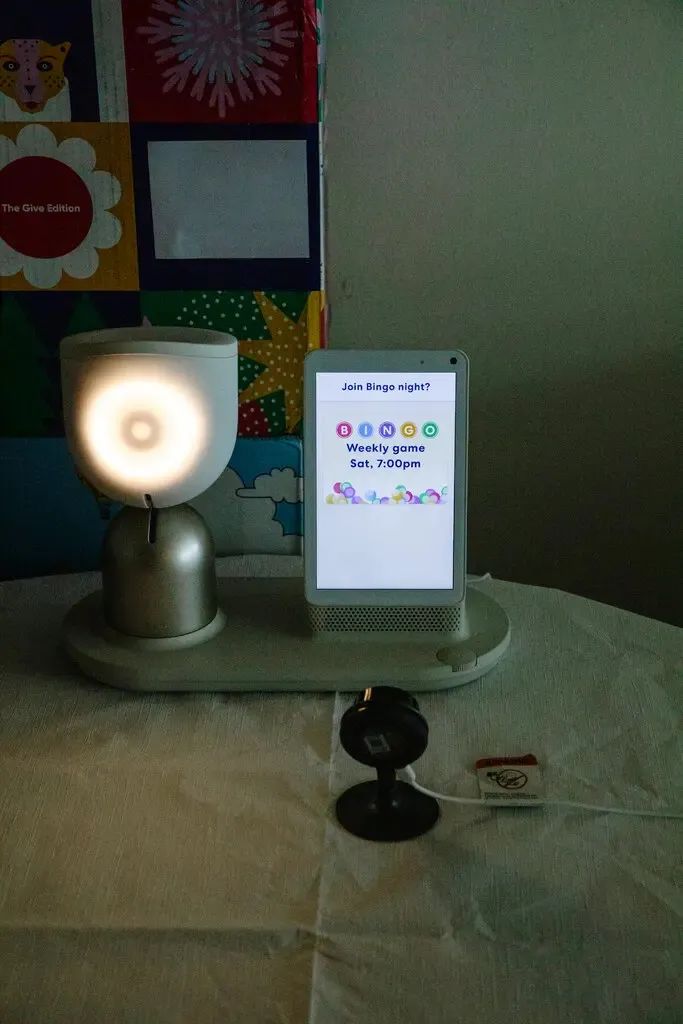

1-1. 由AI驱动的声控机器人伴侣ElliQ: 成美国老年人新宠

ElliQ是一款由AI驱动的声控机器人伴侣,它的研发,体现了纽约州对减轻老年人孤独的关怀。尽管人们在任何年龄段都可能体会到孤独,但老年人要尤其容易,因为他们更有可能离婚或丧偶,同时还要经历身体健康和认知状况的下降。和美国其他地区一样,纽约也在迅速老龄化。过去两年里,州政府官员向数百名老年人免费分发了ElliQ机器人。 ElliQ由以色列初创公司Intuition Robotics研发生产,由一个小型数字屏幕和一个台灯大小独立设备组成。ElliQ可主动发起对话,和人类建立有意义联系。除了分享当天头条新闻、玩游戏和提醒用户服药之外,ElliQ还可以讲笑话,甚至讨论宗教、生命意义等复杂议题。

https://www.163.com/dy/article/J72DDUA50511ABV6.html

ElliQ由以色列初创公司Intuition Robotics研发生产,由一个小型数字屏幕和一个台灯大小的独立设备组成(说话的时候会变亮)

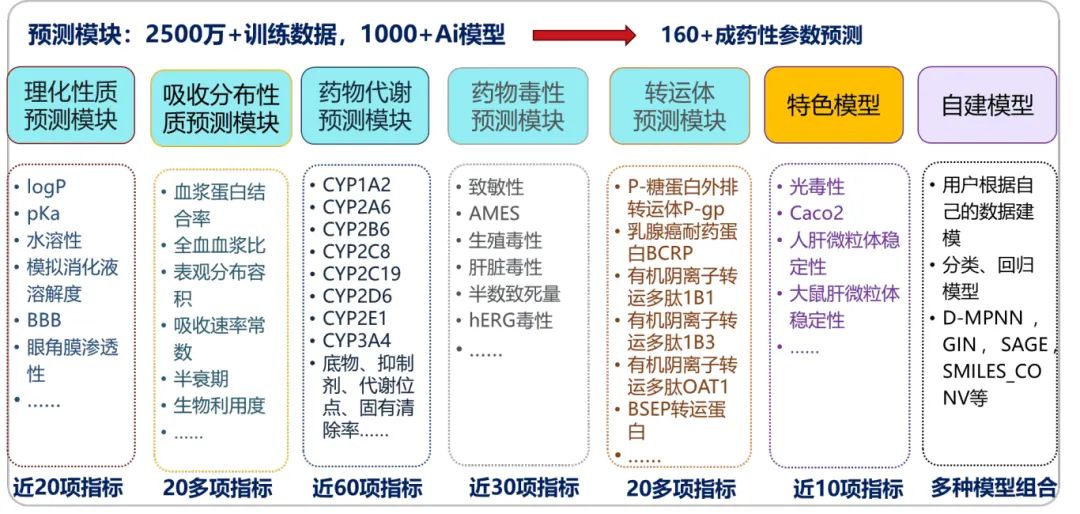

1-2. 全球首款AI全参数成药性预测平台发布:可高效完成160多项参数预测

该平台利用AI技术助力创新药研发,可大大缩短药物研发时间,提高研发成功率。举个例子来讲,研发人员开展一款创新药研发,在筛选出苗头化合物之后,在平台上可用多种方式输入化合物分子结构式,几秒钟就能算出上述苗头化合物成药性参数,加速从苗头化合物到先导化合物的过程,不用像过去那样一一去验证,从而极大地缩短了研发时间。 为了确保预测的准确性和高效性,天智药成在研发前期整理了数千万条关于药物分子成药性各个指标的数据。在此基础上,构建了1000多个AI模型,用于160多项成药性参数的预测,并使用全球已批准药物的真实数据进行了验证。使平台成为全球领先的采用全AI预测ADMET性质的商业化软件。

https://www.sohu.com/a/792010205_121123890

1-3. 山东广播电视台:推出了首档AI数字主播电视新闻专栏《海蓝新声》,该专栏将关注科技创新,探索未来产业布局

《海蓝新声》由山东广播电视台新闻频道《新闻午班车》栏目联合山东一千河数字科技有限公司共同打造,通过AI筛选热点选题、平台一键生成数字主播、文稿AI配音等人工智能制作方式完成,旨在用AI技术为科技资讯报道赋能,以更灵活、生动的视听化呈现方式,让观众沉浸式体验AI技术带来的视觉和交互体验。《海蓝新声》每周日11:30在新闻频道《新闻午班车》栏目中播出 https://sdxw.iqilu.com/share/YS0yMS0xNTc0NjEyMQ.html?sid_for_share=80217_3

1-4. 全国首部AI制作科幻短剧:《三星堆·未来启示录》成都首映

近日《三星堆·未来启示录》第一季在成都进行了全剧的线下首映,引起了观众的热烈反响。这是全国首部完全由AI技术生成的科幻短剧,以三星堆为灵感来源,所以选在成都进行线下首映,具有非常特别的意义。目前,《三星堆·未来启示录》已经在网络平台播出前6集,而这次的线下展映则是放出了全部的13集,让观众提前大饱眼福。 片中充斥着绚丽的大场面和特效,相比起实拍,AI生成显然能更好地控制成本。

https://www.fsddtjw.com/post/11797.html

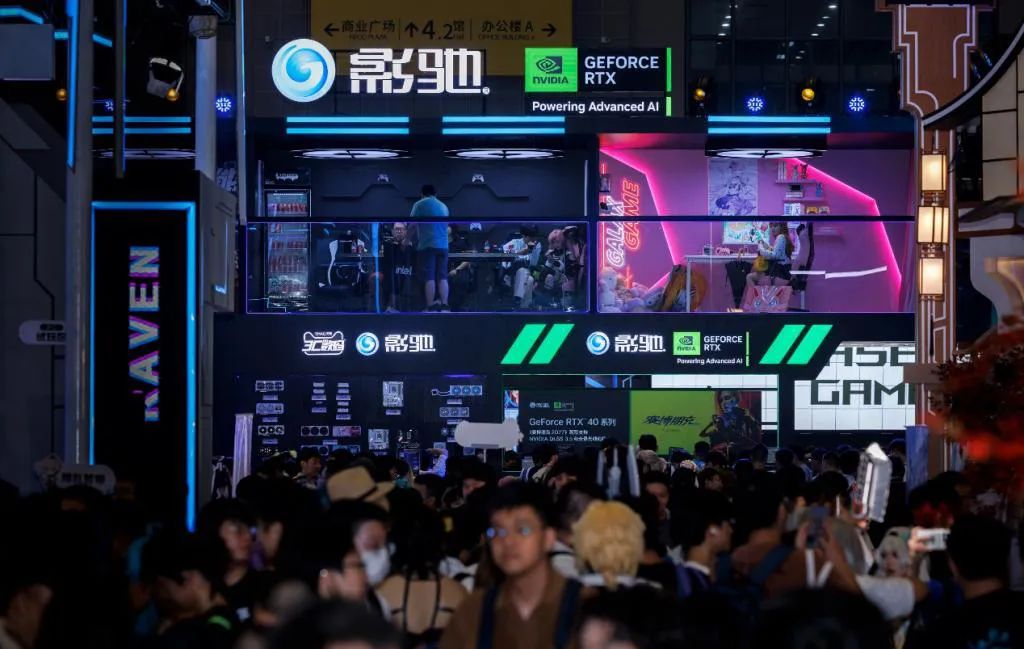

1-5. Bilibili World 2024: RTX AI 强势入场

Bilibili World 2024于7月12日到7月14日,在上海国家会展中心举行。影驰展台布置创新性的采用了水冷机箱的整体结构,创意十足。展区分两层,以一层为主,一层设有 RTX AI PC 体验区、产品区,二层则为桌搭区。RTX AI PC 体验区,在这里,可以体验到 GeForce RTX 40 系列 GPU 强大本地算力加持下的 ComfyUI等 AI 应用。值得一提的是,Stable Diffusion 中两款最受欢迎的应用 Automatic 1111 和 ComfyUI 现在都已经支持通过 TensorRT 加速,可以在原始软件性能的基础上提升至多 60%。 https://mbd.baidu.com/ma/s/BAWtrKLE

AI大模型算法和峰会

2-1. 微软MIT等机构的研究人员提出 训练大模型新范式——公理框架(Axiomatic Framework):6700万参数比肩万亿巨兽GPT-4

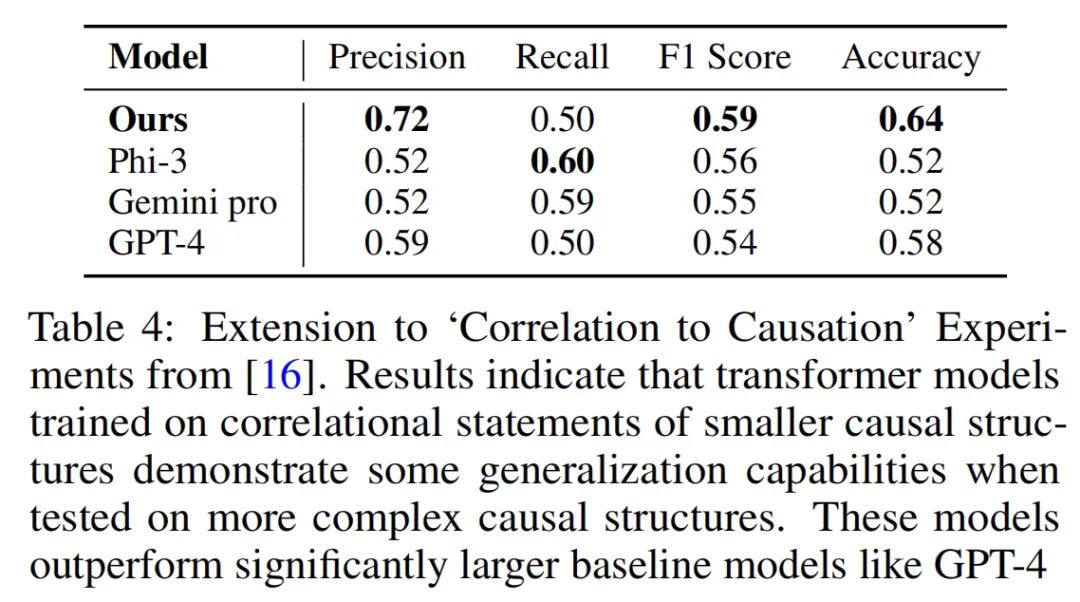

来自微软、MIT等机构的学者提出了一种创新的训练范式,攻破了大模型的推理缺陷。他们通过因果模型构建数据集,直接教模型学习公理,结果只有67M参数的微型Transformer竟能媲美GPT-4的推理能力。在所有评估设置中,公理化训练模型TS2(NoPE)的性能明显优于随机基线,即使因果链的长度超过其训练数据。特别是,模型没有在完全反转的链上进行训练,它的表现也与规模更大的GPT-4模型相当。在其他任务中,它的准确性往往优于或与Gemini Pro、Phi-3等十亿参数规模的模型相当。这些结果表明,经过公理训练的模型可以从简单因果序列的演示中,学会推理更复杂的因果结构。 https://www.163.com/dy/article/J72DDUPI0511ABV6.html

复杂任务下论文提出的小型Transformer模型表现优于所有基线模型,准确率达到64%,比GPT-4高出6%

论文名称:Teaching Transformers Causal Reasoning through Axiomatic Training

论文地址:https://arxiv.org/abs/2407.07612v1

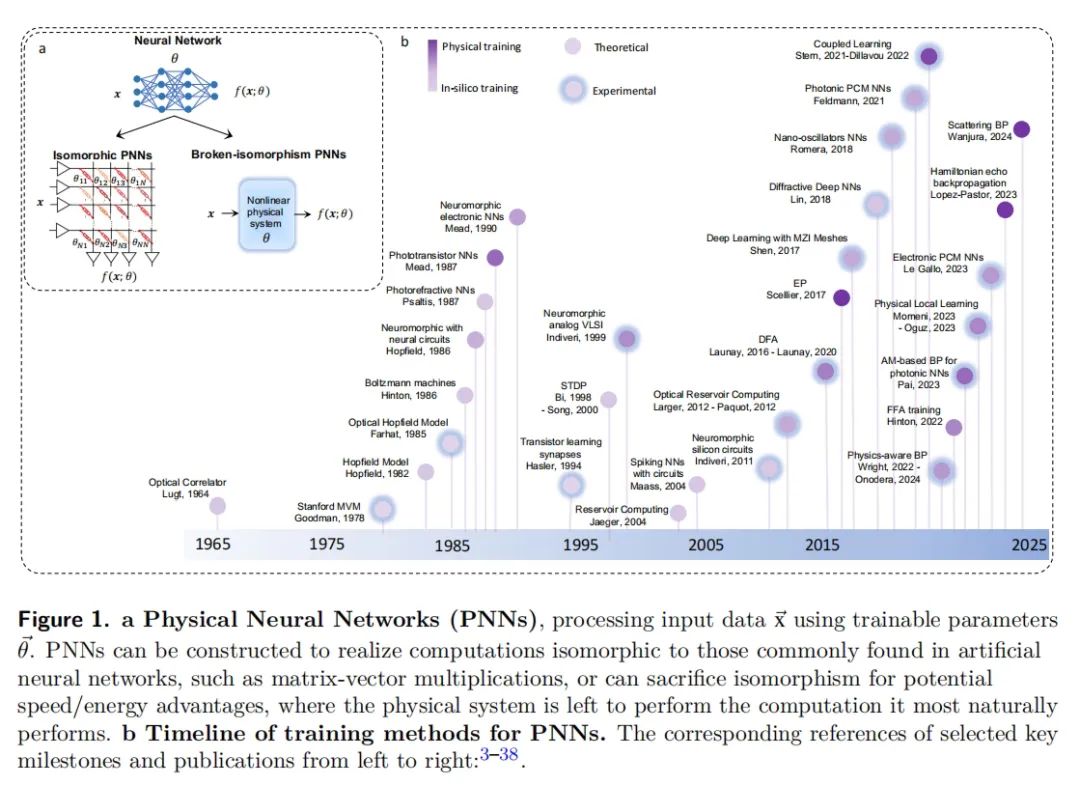

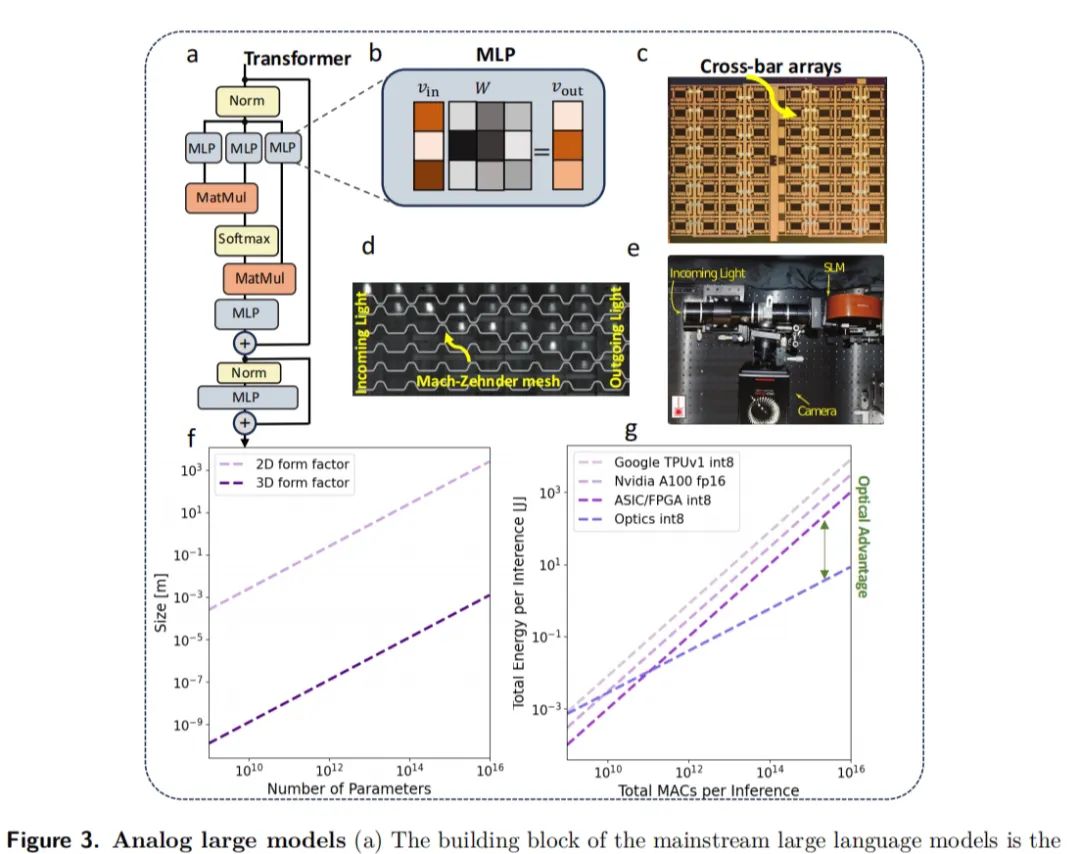

2-2. 物理神经网络PNN(physical neural network):或许根本上改变AI系统的可能性和实用性,实现1000倍的模型规模

随着Scaling Law越来越成功,LLM的电力和算力消耗也逐渐达到了惊人程度。我们越来越难以想象,当前的模型规模如何能再扩大10倍、100倍,甚至1000倍。即使扩大1000倍的模型能够实现,它的能耗还能在人类负担范围内吗?能在智能手机或传感器这些边缘设备上进行本地推理吗? 最近,一篇有关PNN训练的综述性论文登上了HN热榜。作者提出,基于过去几年的研究,我们有理由认为,PNN可以从根本上改变AI系统的可能性和实用性,实现前所未有的模型规模。

https://www.163.com/dy/article/J72DDGQ50511ABV6.html

模拟大型模型

论文名称:Training of Physical Neural Networks

论文地址:https://arxiv.org/abs/2406.03372